Negli ultimi anni i Large Language Model (LLM) come GPT-4, LLaMA, Mistral, Claude e molti altri sono diventati strumenti chiave per gestire e generare contenuti. Questi modelli riescono a comprendere linguaggio naturale e a rispondere a domande complesse, ma presentano anche delle limitazioni tecniche. Una delle sfide principali è fornire a un LLM informazioni estese (ad esempio il contenuto di un intero sito web) rimanendo entro i limiti del suo contesto. È qui che entra in gioco il formato llms.txt.

Cosa sono i file llms.txt?

Un file llms.txt (dove “llms” sta per Large Language Models e .txt indica un file di testo) è un file di testo in formato Markdown posizionato nella directory principale di un sito web (es.: https://iltuosito.com/llms.txt). La sua funzione è fornire ai modelli di linguaggio una panoramica strutturata e semplificata dei contenuti più rilevanti del sito. In altre parole, llms.txt è un riassunto organizzato del sito, pensato non tanto per i motori di ricerca tradizionali, ma per le intelligenze artificiali che dovranno interagire con quei contenuti.

In modo analogo a come il file robots.txt comunica istruzioni ai crawler dei motori di ricerca e la sitemap.xml elenca le pagine del sito, il file llms.txt è una proposta di standard emergente che comunica ai modelli AI cosa c’è di importante nel sito e dove trovarlo. L’idea è di rendere più facile e veloce per un LLM capire la struttura dei contenuti, senza dover analizzare ogni singola pagina HTML completa di menu, grafica e script.

Un file llms.txt tipicamente include:

-

Il nome del sito o progetto (come intestazione principale).

-

Una breve descrizione del sito/progetto (ad esempio obiettivi o temi trattati).

-

Sezioni principali di contenuto, ognuna identificata da un’intestazione e seguita da un elenco puntato di link alle risorse chiave, con brevi descrizioni.

-

Sezione “Opzionale” (se presente), dove elencare contenuti aggiuntivi meno cruciali, che un modello può ignorare se ha vincoli di spazio nel contesto.

In sostanza, llms.txt funge da mappa concettuale del sito per le AI: presenta gerarchicamente le aree tematiche e punta alle pagine o file rilevanti. È scritto in Markdown perché questo formato è facilmente leggibile sia da un essere umano sia da un modello di linguaggio, e permette di avere una struttura gerarchica (intestazioni, liste, ecc.) semplice da interpretare.

Origine e motivazioni del formato llms.txt

L’idea di creare un file dedicato per i LLM nasce dal riconoscimento di un problema: i modelli di linguaggio hanno un contesto limitato, cioè possono elaborare solo una certa quantità di testo per volta (ad esempio qualche migliaio di token). Questo significa che un’AI come GPT-4 non può leggere in un solo colpo tutti i contenuti di un sito web esteso o di una documentazione tecnica lunga centinaia di pagine – semplicemente perché supera la capacità della sua finestra di contesto. Inoltre, quando un LLM prova a estrarre informazioni da pagine web standard, incontra spesso elementi di disturbo (menu di navigazione, banner, codice HTML, JavaScript) che occupano spazio prezioso nel prompt senza aggiungere valore informativo.

Le strategie SEO tradizionali (come ottimizzare il testo per Google o usare metadata e schema.org) funzionano per i motori di ricerca classici, ma non sono pensate per ottimizzare la comprensione da parte delle AI. Un motore di ricerca indicizza pagine e link, mentre un’assistente AI ha bisogno di comprendere il contenuto per rispondere a domande degli utenti in linguaggio naturale. Ecco quindi la motivazione per llms.txt: fornire ai modelli AI un punto di ingresso semplificato ai contenuti di un sito.

Il concetto di llms.txt è stato proposto nella comunità AI attorno al 2024 (accreditato inizialmente all’esperto di AI Jeremy Howard di Answer.ai) proprio per affrontare questa sfida. Invece di lasciare che un LLM debba navigare e interpretare un intero sito web pieno di elementi superflui, il sito stesso può offrire volontariamente un riassunto curato dei propri contenuti in un formato testuale minimale. Così facendo:

-

L’AI ottiene subito le informazioni chiave sulla struttura del sito e dove risiedono i dettagli approfonditi.

-

Si evita di sprecare parte del contesto dell’LLM su codice o testi ripetitivi (come menu presenti identici su ogni pagina).

-

Si aumenta la probabilità che l’AI fornisca risposte corrette e contestualizzate quando attinge ai contenuti del sito.

Un esempio di scenario: immagina un utente che, tramite un assistente AI, chiede informazioni su come usare una certa API documentata sul tuo sito. Se l’AI ha accesso al tuo llms.txt, potrà capire subito quale sezione del sito contiene la API Reference e magari recuperare da lì i dettagli, anziché confondersi tra decine di pagine. In pratica, llms.txt è nato per migliorare l’interazione tra AI e contenuti web, colmando il divario tra come i contenuti sono organizzati per gli umani e come sarebbe ideale presentarli a un modello di linguaggio.

È importante sottolineare che llms.txt è pensato principalmente per l’uso in fase di inferenza da parte dei modelli (cioè quando l’AI sta rispondendo in tempo reale a una domanda), più che per la fase di training. In futuro, se questo formato verrà adottato su larga scala, nulla vieta che possa essere sfruttato anche in fase di addestramento (per esempio, un modello pre-addestrato su tanti llms.txt di siti potrebbe imparare come sono strutturate le informazioni). Ma il focus principale è fornire all’AI informazioni mirate quando serve, riducendo al minimo il carico e la latenza nel reperirli.

Struttura e contenuto di un file llms.txt

Come accennato, llms.txt adotta la sintassi Markdown per organizzare le informazioni. Questa scelta è intenzionale: il Markdown è semplice, lineare e crea una gerarchia logica con simboli che i modelli di linguaggio comprendono naturalmente (come # per le intestazioni, - per gli elenchi puntati, > per citazioni). Inoltre, chiunque può leggere o modificare un file Markdown senza bisogno di strumenti particolari.

Di seguito descriviamo gli elementi tipici che compongono la struttura di un file llms.txt:

-

Intestazione H1 (livello 1): Di norma la primissima linea contiene un titolo di livello 1 (preceduto da

#in Markdown) che indica il nome del sito, progetto o documentazione. Ad esempio potrebbe essere il nome dell’azienda o del prodotto software. Questo fa capire immediatamente all’AI di cosa si tratta. -

Breve descrizione (blockquote): Subito sotto l’H1 spesso si inserisce una descrizione concisa del progetto/sito, formattata come citazione (ovvero con un

>all’inizio). È un piccolo paragrafo che riassume la mission o il contenuto del sito. Ad esempio:> Una piattaforma open-source per la gestione di API e documentazione per sviluppatori.Questa frase aiuta l’LLM ad avere un contesto generale. -

Dettagli facoltativi introduttivi: Dopo la descrizione breve, si possono aggiungere uno o più paragrafi brevi (senza particolari formattazioni di heading) che diano ulteriori informazioni utili. Ad esempio, si potrebbe spiegare come è organizzata la documentazione, o note su come navigare i contenuti. Questi paragrafi rimangono in formato testo semplice o elenco.

-

Sezioni principali (intestazioni H2): Il cuore di

llms.txtè costituito da varie sezioni tematiche, ciascuna introdotta da un’intestazione di secondo livello (##in Markdown). Ogni sezione dovrebbe rappresentare un macro-argomento o una categoria importante del sito. Per un sito di documentazione software, sezioni tipiche potrebbero essere## Documentazione,## API,## Esempi,## Tutorial. Per un sito di servizi, potrebbero esserci sezioni come## Prodotti,## Soluzioni,## Risorse, e così via. Le sezioni creano una mappa mentale organizzata per l’AI. -

Elenchi di link con descrizioni: Sotto ogni intestazione di sezione, si elenca una serie di risorse pertinenti sotto forma di elenco puntato. Ogni punto inizia con un link Markdown alla risorsa (pagina del sito, file PDF, ecc.) accompagnato da una breve descrizione testuale di quel contenuto. Ad esempio:

- [Guida Introduttiva](/docs/guida-intro) - Panoramica per nuovi utenti su come iniziare ad usare il prodotto. In questo modo l’AI vede il titolo della risorsa e subito dopo una spiegazione sintetica di cosa contiene o perché è utile. Questo è fondamentale: invece di presentare solo una lista di URL o titoli, forniamo contesto su ciascuno, aiutando il modello a capire quali link potrebbero essere rilevanti per una certa domanda. -

Sezione “Opzionale”: È prassi (ma non obbligatorio) prevedere l’ultima sezione con un’intestazione

## Opzionale(o “Optional” in inglese). Questa sezione elenca link a materiali aggiuntivi che non sono cruciali. Ad esempio potrebbero esserci collegamenti a pagine secondarie, a risorse esterne, o a approfondimenti molto dettagliati. L’idea è segnalare all’AI che questi elementi possono essere ignorati in caso di mancanza di spazio nel contesto o se cerca solo un quadro generale. In altre parole, tutto ciò che sta sotto “Opzionale” è nice-to-have ma non necessario per la comprensione base. Un modello potrebbe decidere di tralasciare queste parti se ha una finestra di contesto ridotta.

Esempio di codice:

# Titolo del Sito/Progetto

> Breve descrizione del sito o progetto.

(Paragrafo di dettagli introduttivi facoltativo)

## Sezione 1

– [Pagina/Documento 1](URL1): Descrizione breve del contenuto o scopo.

– [Pagina/Documento 2](URL2): Descrizione breve del contenuto o scopo.

…(altre risorse chiave)…

## Sezione 2

– [Risorsa A](URLA): Descrizione…

– [Risorsa B](URLB): Descrizione…

…(altre risorse)…

## Opzionale

– [Risorsa X](URLX): (descrizione facoltativa)

– [Risorsa Y](URLY): …

Questa è la “ricetta” generale. Ovviamente ogni sito potrà adattarla ai propri contenuti. L’importante è mantenere la coerenza e la chiarezza: includere solo le informazioni essenziali e strutturarle ordinatamente. Un file llms.txt prolisso o disorganizzato perderebbe il suo vantaggio, che è proprio la sintesi.

Come si crea e implementa un file llms.txt

Implementare un file llms.txt sul proprio sito è relativamente semplice dal punto di vista tecnico, ma richiede attenzione dal punto di vista dei contenuti. Ecco i passi fondamentali per generarlo e utilizzarlo al meglio:

1. Creazione del file e formato:

Apri un qualunque editor di testo e comincia a scrivere il contenuto seguendo la struttura in Markdown descritta sopra. Assicurati di utilizzare correttamente le sintassi Markdown (un # per l’H1, ## per H2, un trattino - per ogni elemento di lista, ecc.). Includi le sezioni e i link più importanti. Questo step è solitamente manuale: conviene che sia un umano (magari il responsabile dei contenuti o un SEO strategist) a scegliere quali pagine inserire e come descriverle, così da fornire un digest di qualità del sito.

2. Contenuto da inserire:

Seleziona le parti più rilevanti del tuo sito. Non è necessario (né consigliato) elencare ogni singola pagina esistente. Più il file rimane conciso, meglio l’AI potrà utilizzarlo. Concentrati ad esempio su: pagine di documentazione, guide pratiche, articoli fondamentali, sezioni tematiche principali, servizi/prodotti principali, FAQ cruciali. Per ciascuno fornisci una descrizione di una riga o due al massimo. Mantieni un linguaggio neutro e descrittivo, come faresti per una sitemap destinata agli utenti, ma ancora più sintetico. Ricorda che lo scopo è far capire a un modello di intelligenza artificiale (non a un utente umano generico) dove può reperire le informazioni di cui ha bisogno. Quindi puoi anche usare termini più tecnici o espliciti, ad esempio: “API Reference – Documentazione completa delle API REST v2, con esempi di chiamata.” Questo aiuterà direttamente il modello a capire cosa contiene quella pagina.

3. Posizionamento sul sito:

Una volta scritto il contenuto, salva il file e nominalo esattamente llms.txt. Caricalo quindi nella cartella principale (root) del tuo sito web, la stessa dove risiederebbe un robots.txt. In questo modo sarà accessibile tramite l’URL pubblico https://iltuosito.com/llms.txt. È importante che sia in testo semplice (plaintext) e non richieda autorizzazioni particolari per essere scaricato, altrimenti i bot o i sistemi AI non potranno recuperarlo agevolmente. Se hai sia una versione principale sia una documentazione molto corposa, puoi valutare di inserire anche un llms-full.txt separato (come vedremo tra poco).

4. (Opzionale) Implementazione di llms-full.txt:

Alcuni proponenti dello standard suggeriscono di offrire due file: il llms.txt classico che dà la visione d’insieme (una sorta di indice navigazionale), e un secondo file chiamato llms-full.txt che contiene tutto il contenuto testuale principale del sito in un unico posto (ad esempio unendo tutti i documenti Markdown della documentazione). llms-full.txt sarebbe un mega-file che l’AI potrebbe usare se avesse bisogno di maggior dettaglio, fungendo da “guida completa”. Tuttavia, creare un llms-full.txt ha senso solo per siti orientati a documentazione o knowledge base, ed è facoltativo. La maggior parte dei siti potrebbe tranquillamente evitare questo secondo file, oppure limitarlo a includere solo alcune pagine chiave in formato esteso.

5. Aggiungere header HTTP (consigliato):

Per segnalare ulteriormente la presenza di llms.txt ai client automatici, potresti configurare il server web in modo da inviare un intestazione HTTP speciale quando serva il file. Ad esempio, si sta diffondendo l’uso di un header X-Robots-Tag: llms-txt. Questo header non è standard ufficiale, ma l’idea è fornire un hint ai crawler o agenti AI che quel file è un file llms. In pratica è simile alla funzione di X-Robots-Tag usato per indicare file da non indicizzare; qui si riutilizza il concetto per marcare un file come “llms-txt”. Non è obbligatorio, ma potrebbe diventare best practice qualora gli strumenti iniziassero a cercarlo.

6. Verifica e aggiornamento:

Una volta che iltuosito.com/llms.txt è in linea, provalo. Aprilo nel browser come faresti con un normale file di testo per assicurarti che:

-

La formattazione sia corretta (ad esempio i link compaiono tra parentesi e non ci sono errori di Markdown).

-

I link inseriti funzionino e puntino alle risorse giuste.

-

Le descrizioni siano chiare.

Inoltre, controlla il file periodicamente. Aggiornallms.txtogni volta che apporti modifiche significative al sito: se aggiungi una nuova sezione importante, se riorganizzi la documentazione, ecc. Mantenere questo file allineato alla realtà del sito è essenziale affinché sia utile. Esattamente come aggiorneresti una sitemap.xml quando aggiungi pagine nuove, dovresti aggiornare llms.txt quando aggiungi contenuti di rilievo.

7. Automazione (tool di generazione):

Per siti di grandi dimensioni può essere laborioso creare e mantenere llms.txt manualmente. In aiuto possono venire alcuni strumenti: ad esempio esistono già script e tool open source che generano un file llms.txt partendo dalla sitemap XML del sito, oppure integrandosi con generatori di documentazione (ci sono CLI come llmstxt by dotenv o servizi come Firecrawl llms.txt generator). Questi strumenti scannerizzano la struttura del sito e producono un file Markdown con link e titoli. Tuttavia, anche usando tool automatici, è raccomandabile rivedere e rifinire manualmente il risultato: l’automazione può elencare tutti i link, ma solo tu sai quali sono davvero utili e come descriverli al meglio per un AI.

8. llms.txt in sottocartelle (casi avanzati):

Lo standard prevede principalmente un file a livello root. Ma se hai un sito molto vasto con sezioni quasi indipendenti (per esempio documentazioni separate per diversi prodotti), potresti teoricamente creare file llms.txt anche per sottosezioni, posizionandoli nelle relative sottodirectory. Ad esempio iltuosito.com/prodottoA/llms.txt per i contenuti di Prodotto A e iltuosito.com/prodottoB/llms.txt per Prodotto B. In questo caso, il file principale all root potrebbe linkare ai llms.txt secondari. Questa è però una casistica avanzata e non molto diffusa al momento.

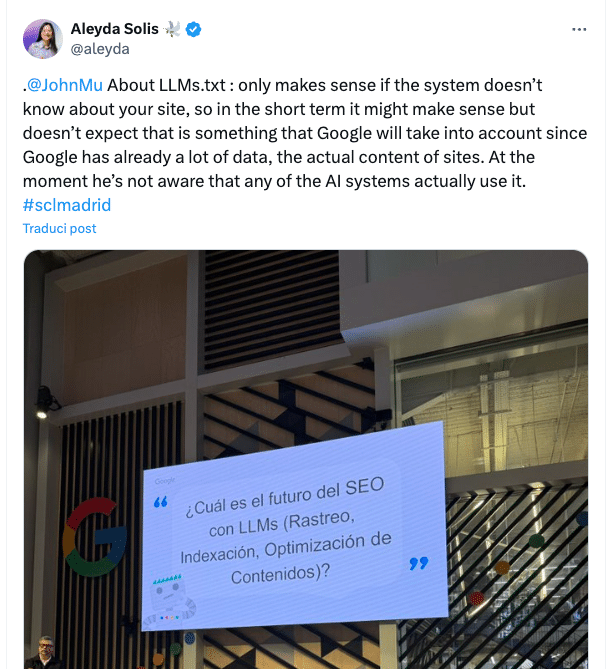

Completati questi passi, il tuo llms.txt è attivo. Da solo, questo file non “fa nulla” in automatico (non è che Google lo leggerà come fa con la sitemap, almeno non ancora). Ma è pronto ad essere utilizzato da chiunque (umani o AI) ne conosca l’esistenza o lo cerchi esplicitamente. Nel nostro corso DeepSEO vedremo appunto come i modelli di AI possono utilizzarlo in concreto.

È cruciale capire che attualmente (inizio 2025) la maggior parte degli LLM non scopre né legge autonomamente il file llms.txt di un sito, a meno che non venga esplicitamente istruita a farlo.

Questo Formato che attualmente NON è uno standard è ancora nuovo e in fase embrionale: non c’è (ancora) un “Googlebot delle AI” che visita regolarmente il tuo sito per processare llms.

llms.txt nelle moderne strategie SEO e content generation

L’introduzione di llms.txt si colloca in un contesto più ampio di evoluzione del mondo SEO e del content marketing nell’era dell’intelligenza artificiale. Vediamo qualche riflessione su come questo formato si relaziona alle pratiche odierne:

1. SEO per motori di ricerca vs “SEO per AI”: Tradizionalmente fare SEO significava ottimizzare un sito per piacere agli algoritmi di Google (e simili): contenuti di qualità, parole chiave, backlink, performance, markup, ecc. Ora sta emergendo l’idea che bisogna ottimizzare i contenuti anche per gli algoritmi di intelligenza artificiale che forniscono risposte agli utenti. Ad esempio, se un utente pone una domanda a ChatGPT o Bard riguardo un certo argomento e la risposta viene attinta anche dai nostri contenuti, vogliamo che l’AI “conosca” bene i nostri contenuti per riportarli accuratamente (magari citando il nostro brand). Questo è un nuovo fronte che alcuni chiamano SEO per AI o AIO (AI Optimization). Il file llms.txt può essere visto come uno degli strumenti di questa nuova ottimizzazione: analogamente a come una meta description riassume una pagina per Google, llms.txt riassume il sito per un’AI. Insomma, i SEO più lungimiranti potrebbero iniziare ad includere la creazione di llms.txt nelle loro checklist, per prepararsi a un futuro in cui i chatbot AI avranno un ruolo nell’indirizzare traffico e visibilità.

2. Contenuti di qualità e contesto consolidato: Dal punto di vista della generazione di contenuti, le AI vengono già ampiamente usate per scrivere articoli, descrizioni prodotto, post social, ecc. Tuttavia, uno dei rischi è la coerenza e accuratezza di ciò che generano. Se un’azienda vuole usare un LLM per produrre contenuti ottimizzati SEO sul proprio sito, avere un llms.txt ben fatto può aiutare perché l’AI avrà un riferimento di cosa è già presente e come è strutturato. Ad esempio, se un copywriter AI deve creare un nuovo articolo per il blog aziendale, facendogli leggere prima il llms.txt del sito, potrà comprendere il tono generale, i temi già trattati (evitando duplicazioni) e individuare eventuali gap da coprire. È un po’ come dare all’AI la “mappa editoriale” del sito prima di fargli scrivere qualcosa di nuovo.

3. Featured snippet e one-box answers degli assistenti AI: Nei motori di ricerca tradizionali esistono i featured snippet (quelle risposte rapide in cima ai risultati). Nel mondo AI, l’intero risultato potrebbe essere una risposta elaborata dall’AI, spesso attingendo a varie fonti. Se il nostro sito ha un llms.txt, potenzialmente un assistente AI potrebbe preferire usarlo per capire la struttura prima di generare la risposta, e questo potrebbe aumentare la probabilità che vengano incluse informazioni provenienti dal nostro sito (perché rese facilmente accessibili). È teoria al momento, ma alcune voci suggeriscono che in futuro i siti forniranno non solo sitemap per farsi indicizzare ma anche llms.txt per farsi comprendere, e che gli algoritmi di ranking AI-based ne terranno conto come segnale di qualità (un sito che si preoccupa di fornire llms.txt potrebbe essere visto come più AI-friendly).

Il mondo SEO cambia sei pronto? 🙂

Vuoi saperne di più e come implementare AI in modo corretto nei tuoi progetti SEO? Scopri il nostro corso SEO